“Chat XiPT”有什么问题比中国更大-彭博社

Catherine Thorbecke

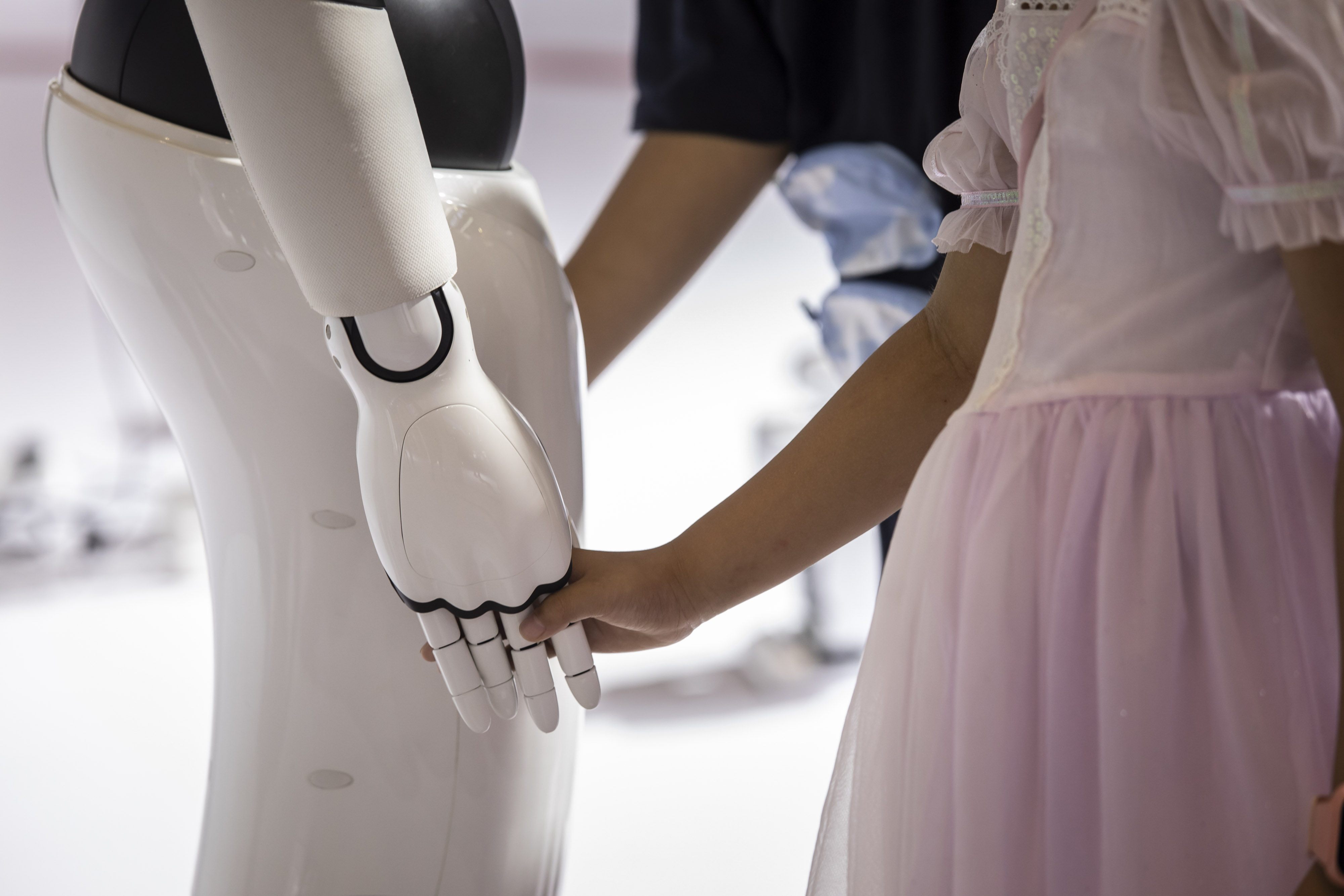

不,它们不是人类。

不,它们不是人类。

摄影师:神奇/Qilai Shen/Bloomberg 解决一个备受关注的社会问题。

解决一个备受关注的社会问题。

摄影师:法新社/法国广播公司图片

北京为具有核心社会主义价值观的聊天机器人大力推动是其在争夺人工智能霸权的竞赛中赶上美国的最新障碍。这也及时提醒世界,聊天机器人不能拥有自己的政治信仰,就像不能期望它做出人类决策一样。

西方指责的观察者很容易抓住最近的报道,称中国正在强迫公司接受密集的政治测试,作为AI发展将受到政府审查制度打压的更多证据。这一艰难的过程为科技公司增加了一层繁琐的工作,限制了实验的自由可能会阻碍创新。注入特定价值观的AI模型的困难可能会在短期内损害中国创建与美国一样复杂的聊天机器人的努力。但这也揭示了对AI现实的更广泛误解,尽管全球军备竞赛和一大堆行业炒作推动了其增长。

Bloomberg观点习近平不喜欢银行家。他有理由不要掠夺骗局哈里斯称特朗普为掠夺者,选民会听谷歌被Wiz拒绝230亿美元,双方都会受到伤害自2022年底OpenAI的ChatGPT推出以来,全球生成式人工智能狂潮开始,从美国到中国都有一种倾向,即将这种新兴技术拟人化。但是,将人工智能模型视为人类,并期望它们表现出人类的方式,对于这项仍处于初级阶段的技术来说是一条危险的道路。中国错误的做法应该作为一个警钟。

北京的人工智能雄心已经受到来自美国全力阻止获取先进半导体和芯片制造设备的努力的严重威胁。但中国互联网监管机构也试图对国内人工智能模型的输出施加政治限制,确保它们的回应不违背共产党的理念,也不对习近平等领导人说出坏话。公司正在限制训练数据中的某些短语,这可能会限制整体性能和产生准确回应的能力。

此外,中国人工智能开发者已经处于劣势。在线英语文本比中文文本要多得多,可以用于训练数据,甚至没有考虑到被防火墙屏蔽的内容。大型语言模型的黑匣子性质也使得审查输出本质上具有挑战性。一些中国人工智能公司现在正在构建一个单独的层到他们的聊天机器人上,以实时替换有问题的回应。

但简单地将其技术实力限制在长远发展中是不明智的。北京希望到2030年成为全球人工智能领导者,并正在动用国家和私营部门的全部力量支持这一努力。政府在上周的第三中央全会上重申了发展高科技产业的承诺。在以自己的方式竞相开发人工智能的过程中,中国开发人员也被迫以新颖的方式接近LLM。他们的研究有可能加强人工智能工具,使其更适用于他们传统上难以应对的更困难的任务。

美国的科技公司花费了多年时间试图控制人工智能模型的输出,确保它们不会产生幻觉或发表冒犯性回应 — 或者,就埃隆·马斯克而言,确保回应不会太“觉醒”。许多科技巨头仍在努力弄清楚如何实施和控制这些类型的防护措施。

今年早些时候,Alphabet Inc.的Google在其人工智能图像生成器创建了历史不准确的描绘,将有色人种描绘成了白人。微软早期的人工智能聊天机器人Tay在2016年因在Twitter上被利用并开始发表种族主义和仇恨言论而臭名昭著地被关闭。因为人工智能模型是在从互联网上抓取的大量文本上进行训练,它们的回应可能会延续种族主义、性别歧视和其他许多在那里固有的黑暗特征。

像OpenAI这样的公司已经在减少不准确性、限制偏见和改善聊天机器人的整体输出方面取得了巨大进展 - 但这些工具仍然只是在人类工作的基础上训练的机器。它们可以被重新设计和调整,或者被编程不使用种族歧视性言论或谈论政治,但它们无法理解道德或自己的政治意识。

中国推动确保聊天机器人遵循党的路线的努力可能比美国公司对其人工智能工具自我施加的限制更极端。但来自地球不同一侧的这些努力揭示了我们在如何共同应对人工智能方面存在深刻的误解。世界正在投入大量资金和巨大量的能量来创建对话聊天机器人。与其试图赋予机器人人类价值观并投入更多资源使它们听起来更像人类,我们应该开始思考它们如何可以帮助人类。

更多来自彭博观点:

- 日本应该大手笔发展创业公司:Catherine Thorbecke

- 托尼·布莱尔应该停止助长人工智能炒作:Parmy Olson

- 谁来管理电网:人类还是机器人?:Liam Denning

想要更多彭博观点吗?OPIN <GO>。或者您可以订阅我们的每日新闻简报。

华尔街和主街之间的脱节正在中国达到临界点。

习近平主席明确表示他不喜欢银行家,也不确定他们对社会有什么价值。他强大的反腐机构正在对最大的银行和金融监管机构进行新的检查,距离上一轮检查仅仅三年。 工资上限和更严格的追索条款正在制定中央企业。 新的立法关于金融各个方面的监管,从股东权益到保险公司的风险敞口,正在酝酿中。