SEC的人工智能打击行动预示着案件的涓涓细流将变成洪流 - 彭博社

Will Kubzansky

加里·根斯勒,美国证券交易委员会主席摄影师:塞缪尔·科伦/Bloomberg

加里·根斯勒,美国证券交易委员会主席摄影师:塞缪尔·科伦/Bloomberg 不,AI并不是魔法。

不,AI并不是魔法。

摄影师:加雷斯·卡特莫尔/Getty Images 欧洲 OpenAI首席执行官萨姆·奥尔特曼(左)在6月10日的苹果全球开发者大会(WWDC)期间与苹果的埃迪·库对话。

OpenAI首席执行官萨姆·奥尔特曼(左)在6月10日的苹果全球开发者大会(WWDC)期间与苹果的埃迪·库对话。

摄影师:贾斯汀·沙利文/Getty Images 北美最近一系列美国执法行动很可能只是对公司夸大人工智能对投资者的吹嘘行为进行打击的开始。

自3月以来,证券交易委员会指控了三家公司所谓的AI洗白行为,即误导性地陈述他们如何使用机器学习和其他工具。这些举措是在该机构主席加里·根斯勒以及监管机构的首席执法律师就围绕这项技术的错误陈述发出多次警告之后采取的。

尽管根斯勒曾称AI为“本代最具变革性的技术”,但他也表示它可能引发金融危机,并警告公司不要夸大其词。即使在最近的SEC案件之前,该机构已提出了针对使用AI的经纪商和顾问的新限制。

阅读更多: 华尔街使用人工智能、数据分析面临新的SEC规定

“我们已经到了SEC的每个部门都非常关注这一点的阶段,包括执法部门,”Akin Gump Strauss Hauer & Feld的合伙人Brian Daly说道。

SEC的一位代表拒绝置评,除了之前机构发出的警告之外。

与此同时,Sidley Austin的合伙人W. Hardy Callcott表示,SEC迄今就人工智能洗白问题提起的执法案件类似于一些公司就Covid治疗和ESG发表的声明。美国证券规则禁止公司向投资者提供虚假陈述。

上周,SEC起诉了Joonko的创始人兼前任负责人,这家现已关闭的招聘平台声称利用人工智能将公司与来自少数群体背景的候选人联系起来。在指控中,SEC表示Joonko并未使用其声称采用的人工智能能力。

据SEC称,该公司的董事会据称在2023年6月意识到其创始人Ilit Raz伪造了合同、伪造了银行对账单,并夸大了公司付费客户的数量。

SEC列出的代表Ilit Raz的律师未回复多次要求评论。 Raz没有立即回复LinkedIn上的消息。

“虚假和误导性陈述”

三月份,Delphia(美国)公司和Global Predictions公司同意支付合计40万美元以解决SEC关于他们对人工智能使用的所谓“虚假和误导性陈述”的指控。 Global Predictions的律师拒绝置评,而Delphia的律师未回复评论请求。 在解决案件时,两家公司均未承认或否认SEC的指控。

阅读更多: SEC对两家公司因虚假人工智能声明处以罚款

律师们看到SEC在其努力遏制加密行业的早期阶段采取的一些类似做法。 但他们强调,数字资产以一种人工智能无法做到的方式违反了监管机构的规定。

美国大学金融与证券法教授Hilary Allen表示,人工智能和加密是非常不同的,但最近的行动是“每次发生新的热门事件时都会看到的案例”。 她补充说,几年前SEC曾打击“加密洗牌”和欺诈性首次代币发行。

“最终总会有人试图利用技术获取利益,”她说。“这是以低成本方式进行的。 随着时间的推移,我相信会有更多复杂的尝试。”

硅谷有人知道“树大招风”这句谚语吗?也许他们迟早会明白。

科技公司领导人应该对英伟达公司的迅速崛起感到不安,现在人工智能热潮推动这家芯片制造商成为全球市值最高的公司[。这家公司向少数几家云巨头销售备受追捧的人工智能芯片,这些公司正在从人工智能炒作中获利,尽管未来前景看起来更加暗淡。很难想象英伟达首席执行官黄仁勋如何能够维持这样的增长(即使他正在引导公司转向销售软件),他可以感谢自己和同行。像谷歌母公司Alphabet Inc.、亚马逊公司和微软这样的科技巨头已经扭曲了对生成式人工智能对利润的贡献的期望。如果他们不调整期望,他们将为此付出代价。](https://www.outputnews.com/2024/bloomberg/news_2024_06_19_766363)

彭博观点交易员与日本银行上田不合拍如何在南中国海中扳回局势维珍轨道公司曾被虚假收购被定罪变得更容易了谷歌最近的推文总结了他们犯的错误:

不,谷歌。人工智能并不是“魔法”。即使在一条推文中将其描述为如此,也已经导致了失望。远离英伟达的光芒,价值链下游,隐藏着不满的迹象。出于对幻觉、成本和数据安全的担忧,企业已经削减了对新型人工智能工具的支出。根据软件公司Lucidworks Inc.最近对2500名企业领导进行的调查,计划在未来12个月增加对人工智能支出的全球公司比例已经从一年前的93%下降到了63%。与此同时,据美国人口普查局称,只有5%的美国公司在使用人工智能。

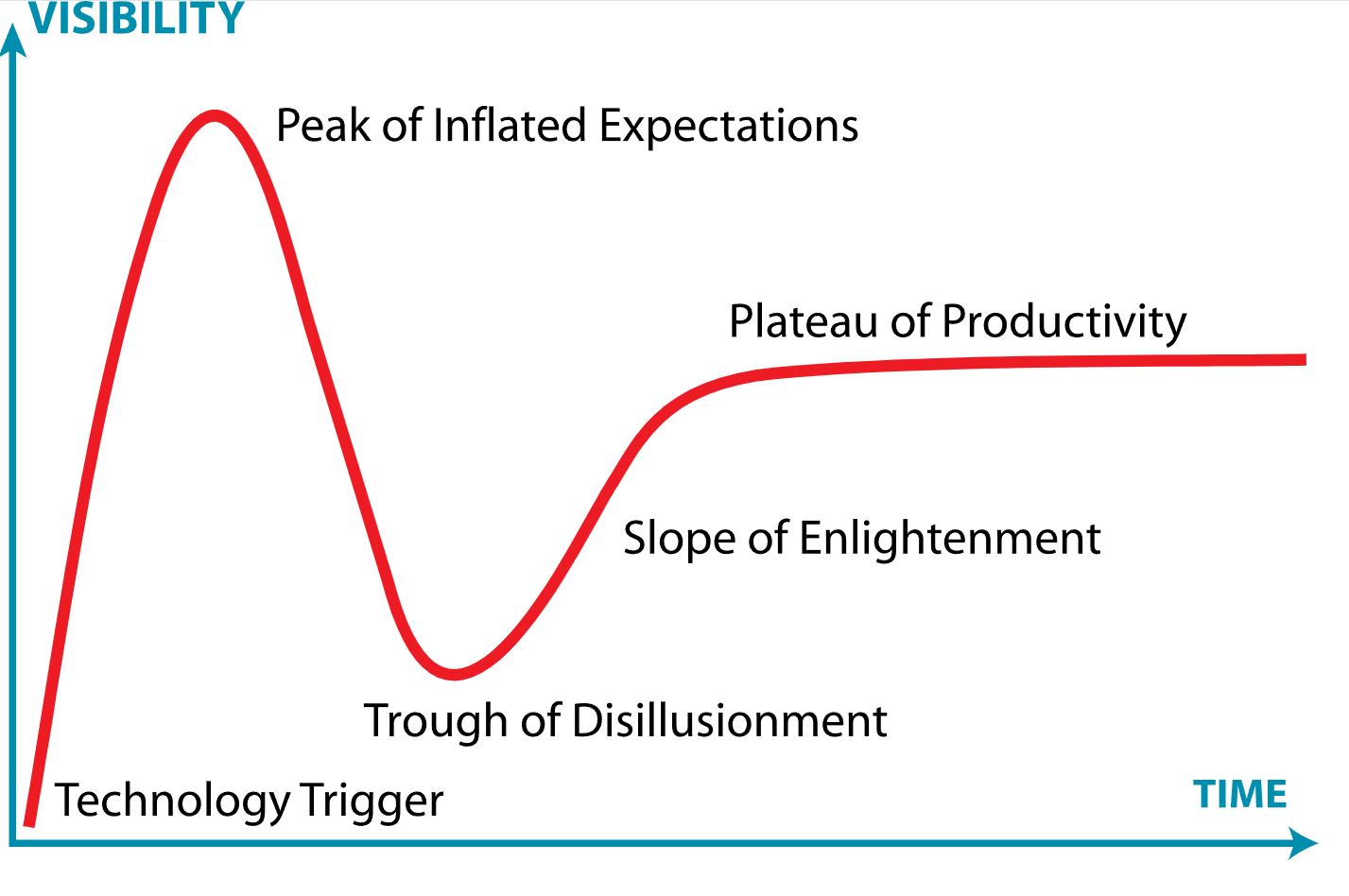

如果用Gartner的炒作周期来衡量这种情绪,人工智能已经深陷于“幻灭槽”中:

Gartner的炒作周期来源:维基百科Gartner的图表展示了新技术的常见路径,并暗示一旦其真正的用途被市场认知,就可以达到“高原”状态。如何达到这一点?首先,科技公司需要确定他们的炒作机器出了什么问题。他们没有将人工智能的能力期望设定得太高;他们将其用途框定为太过通用。

Gartner的炒作周期来源:维基百科Gartner的图表展示了新技术的常见路径,并暗示一旦其真正的用途被市场认知,就可以达到“高原”状态。如何达到这一点?首先,科技公司需要确定他们的炒作机器出了什么问题。他们没有将人工智能的能力期望设定得太高;他们将其用途框定为太过通用。

这在一定程度上可以归咎于OpenAI的领导人Sam Altman和谷歌人工智能部门的领导人Demis Hassabis,他们都追求建造具有“通用”智能的计算机的宏伟目标,然后引发了最近的人工智能竞赛。人工通用智能(AGI)是一个模糊的术语,指的是可以超越人类多方面能力的计算机,从而解决各种问题。问题就在这里。

有时,科技公司有一个明确的北极星可供瞄准。想想Salesforce公司的愿景,帮助公司通过其软件工具更好地与客户联系,或者Netflix公司试图成为全球领先的流媒体娱乐服务提供商。OpenAI和Google的AGI目标甚至更宏大,以至于它们已经失去了所有意义,从根据Sam Altman的说法为人类创造丰富的财富,到根据Hassabis的说法解决气候变化和治愈癌症。

AI炒作机器正在行动

芯片制造商英伟达已成为全球市值最高的股票

来源:彭博社

当激动人心的理想主义梦想渗入销售和营销渠道时,AI的潜在用途变得不明确。将AI框定为通用的瑞士军刀以提高生产力,最终会导致其最终用户陷入瘫痪:对于一种可以做任何事情的技术,你该从何处开始呢?

关于AI的真相是,当人们有时间去尝试它时,它可以是有用的,甚至在财务上有益。技术的最大支持者应该记住移动技术的出现是如何起飞的,办公室工作者带着他们的早期iPhone和其他个人设备进入工作场所,并要求IT将它们连接到企业电子邮件系统。同样的现象可能会发生在生成式AI上,因为一些最成功的案例研究来自将其用于个人生产力的个人。

最近《纽约时报》的一个轶事很好地说明了这一现象:最近的纽约时报报道。

“Allison Giddens,Win-Tech的联合总裁,这家总部位于乔治亚州肯尼索的航空航天制造公司有41名员工,她说大约六个月前开始使用ChatGPT来处理一些运营任务,比如给员工写邮件、分析数据以及起草公司前台的基本流程。她电脑显示器上贴着一张纸条,上面简单写着“ChatGPT”,提醒她使用这项技术… 但她在更广泛地实施它并利用它使公司更高效方面面临困难。”

强迫大量员工使用“通用”技术是注定失败的。当微软、谷歌和亚马逊推销他们的人工智能工具时,他们应该警告客户这项技术可能需要数年才能适应,并更明确地缩小潜在的用例。例如,使用它来为客户提供基于文本的回复可能比调整人工智能进行预测更成功,根据Lucidworks的调查。

麦当劳公司的失败的AI驾驶通道就是一个例子。它依赖于通过麦克风接收人们的订单,但被背景噪音搞混了。但支付公司Klarna Bank AB采用了不同的方法,利用ChatGPT技术进行基于文本的客户服务,取得了更大的成功。结果导致其在2024年第一季度将销售和营销支出减少了11%。

人工智能还不是万事通,但是在一些领域里已经成为专家。商业领袖越早意识到他们可以将其应用于各种领域,而不是一刀切地应用于所有事情,到处都是,他们就越能让这项技术对他们有用。但是他们需要来自科技公司更加冷静的指导,这些公司必须抵制将人工智能宣传为一种通用快速解决方案和“魔法”的做法。如果他们不这样做,这样的言论将助长泡沫。

更多来自彭博观点:

- 人工智能告密者 正在站出来。是时候了:Parmy Olson

- 苹果的 音乐盲iPad广告 触发了我们最糟糕的人工智能恐惧:Dave Lee

- 人工智能正在让机器人变得更聪明。 它们需要界限:Thomas Black

想要更多彭博观点吗? OPIN <GO>****。或者您可以订阅 我们的每日新闻简报**。**

这里有一个人工智能进步,应该使我们所有人受益:人工智能构建者更容易警告世界,他们的算法可能造成的危害 — 从传播错误信息和取代工作,到 产生幻觉 和提供一种新形式的 监视。但是这些潜在的告密者可以向谁求助呢?一个鼓舞人心的转变正在进行中,这要归功于对补偿政策的变化,工程师们重新发声的势头以及一家得到英国政府支持的安全组织的日益增长的影响力。

金融变化是最重要的。 AI工作者面临着终极第一世界问题,如果他们与正确的公司合作几年,并且在离开时保持对其问题的沉默,他们可以通过股票期权赚取七位数或八位数的收入。根据Vox最近的报道,如果被发现说出来,他们就失去了成为百万富翁的机会。根据本月由13名前OpenAI和Google DeepMind员工发布的一封公开信,其中六人选择匿名,这使得许多人保持沉默。