OpenAI的ChatGPT是用来做什么的?没什么好事 - 彭博社

Max Chafkin

插图:Yoshi Sodeoka for Bloomberg Businessweek

插图:Yoshi Sodeoka for Bloomberg Businessweek

欢迎来到Bw Daily*,这是新的Bloomberg Businessweek简报,在这里我们将为您带来有趣的声音、优秀的报道以及杂志的魅力,每个工作日都会更新。通过给我们的编辑发送电子邮件告诉我们您的想法!* *如果这封邮件是被转发给您的,请点击这里注册**。废话不多说…*

即时满足

- 苹果的巨额利润帮助其度过科技风暴。

- 美国的儿童保育已经承受压力,而更多痛苦即将到来。

插图:Yoshi Sodeoka for Bloomberg Businessweek回到2009年,当大多数行业前景黯淡,硅谷的拯救世界潜力仍然被认真对待时,Wired杂志发表了一篇赞赏的文章,介绍了一家名为Demand Media Inc的初创公司。这家公司由MySpace母公司的前首席执行官共同创立,当时它似乎找到了在线内容的自然演进方式:不再试图通过增加收入来支付新闻报道的成本—就像当时的报纸和杂志正在做的那样—Demand使用软件大幅削减成本并大规模生产文章。它每篇文章支付约15美元,并由算法选择主题,其中许多是如何教程。其想法是通过操纵搜索排名,使Demand的低成本文章排在谷歌搜索结果的前列。

插图:Yoshi Sodeoka for Bloomberg Businessweek回到2009年,当大多数行业前景黯淡,硅谷的拯救世界潜力仍然被认真对待时,Wired杂志发表了一篇赞赏的文章,介绍了一家名为Demand Media Inc的初创公司。这家公司由MySpace母公司的前首席执行官共同创立,当时它似乎找到了在线内容的自然演进方式:不再试图通过增加收入来支付新闻报道的成本—就像当时的报纸和杂志正在做的那样—Demand使用软件大幅削减成本并大规模生产文章。它每篇文章支付约15美元,并由算法选择主题,其中许多是如何教程。其想法是通过操纵搜索排名,使Demand的低成本文章排在谷歌搜索结果的前列。

这种反乌托邦的商业模式被称为“内容农场”,当时的常识认为这是媒体的未来。Demand从风险投资者那里筹集了数亿美元。它最终以比纽约时报公司更高的市值上市,这似乎并不令人意外,因为科技预言家认为该报纸面临即将破产,除非它找到一种向内容农场模式转变的方式。

这一预测最终被证明是错误的,原因在回顾时似乎显而易见,但当时完全逃脱了未来主义者的注意——即农场生产的内容很糟糕。Demand Media的文章更像是对常识的重新陈述,只有乍一看才显得有条理。例如,“如何购买加拿大的Molson”中建议读者“去最近的售卖酒精和Molson产品的商店”。(要了解科技巨头在假扮媒体大亨时有多无能,我强烈推荐这篇令人捧腹的2010年回顾Demand最佳作品,其中还包括“如何购买合适的避孕套”和“如何穿上速干泳裤”。)谷歌最终找到了阻止这类故事从SEO方式登上搜索结果页面的方法,Demand的股价也随之暴跌。

我一直在思考 Demand Media 的兴衰,同时也一直在关注 OpenAI 创建的新聊天机器人 ChatGPT 所受到的热情欢迎。OpenAI 最初得到了埃隆·马斯克的支持,并从微软公司筹集了 10 亿美元,开发了一些备受关注的服务,属于高级计算机科学类别,被称为“生成式人工智能”。这些服务会扫描网络上的文本和图像,然后使用机器学习模型来响应用户请求并创建新图像(比如 Dall-E 的情况)或新文本(比如 ChatGPT 的情况)。这里的“新”并不真正意味着“原创”。OpenAI 的工具实质上是在创作 拼贴作品,就像一个学生可能从几个网站中摘取段落,然后使用词典来更改一些词汇,使抄袭不那么明显。

OpenAI 的拼贴作品有时很有趣,偶尔甚至令人惊讶,特别是当使用软件的人要求它结合本来不协调的概念时。你可以要求 Dall-E 给出一幅猫在游泳池里喝鸡尾酒的图片,或者要求 ChatGPT 写一首关于复式记账的维兰诺诗。回应很少完全正确 —— 我尝试了十几次才得到一个尚可接受的游泳池猫,而我的会计维兰诺诗未能遵守该形式的基本规则 —— 但新奇感很有趣。

几周来,社交媒体上充满了这些创作的例子,吸引了超过一百万人在几天内访问ChatGPT,并导致过热的与iPhone的比较以及对OpenAI增长潜力的疯狂猜测。根据The Information的报道,最近的估值接近200亿美元,尽管该科技出版物估计其收入仅为数千万美元。

OpenAI的估值与人们实际愿意为其软件支付的金额之间的巨大鸿沟并没有阻止未来学家看到一个拐点。极端自由主义投资者Balaji Srinivasan在Twitter上幻想个性化AI生成的电影和“结束20世纪的大众传媒之苦的一天”。令人惊讶的是,许多媒体或多或少地接受了这一极端预测。Vox警告计算机“在各个方面超越人类”。《纽约时报》的Kevin Roose问道ChatGPT是否意味着“所有白领知识工作的终结,以及大规模失业的前兆。”

事实是:ChatGPT的输出很像那些旧的Demand Media文章,或者说,像任何懒惰的17岁孩子匆忙拼凑的文章一样。它或多或少是连贯的,但也通常是显而易见且自相矛盾的。一开始你可能没有注意到这一点,因为ChatGPT听起来像人类的能力令人印象深刻。但当你花更多时间与机器人交流时,你会开始注意到,正如《大西洋月刊》的Ian Bogost指出的那样,ChatGPT的输出“更多地是关于卓越的胡扯,而不是有说服力的写作。”正如Bogost所写的,“比你想象的要愚蠢。”

向ChatGPT提问,你可能会得到几乎与“如何购买加拿大Molson啤酒”长度和深度几乎相同的回答,尽管可能会有更多的事实错误和严重的遗漏。(当我问它关于啤酒的问题时,ChatGPT建议我尝试Uber Eats,但没有提到酒吧。)聊天机器人,就像专家胡扯艺术家一样,倾向于严格遵循形式,对实质漠不关心。它们实际上并不了解世界,而是训练在可能存在偏见和不可靠的数据集上。因此,它们可能会吐出种族主义、性别歧视的回应,或者重复事实不准确的信息,因为这些信息是它们接受训练的数据中的一部分。它们也容易意外地混合无关的想法,制造新的错误,或者在人工智能世界中被称为“幻觉”。OpenAI首席执行官Sam Altman已经承认了这些局限性。“现在依赖它进行任何重要事情都是错误的,”他在推特上写道,描述ChatGPT。

这就是为什么谷歌开发了类似的聊天机器人LaMDA,迄今为止还没有尝试将其作为潜在的搜索引擎替代品。上周,CNBC报道称,在一次全员大会上,该公司人工智能部门负责人Jeff Dean警告了聊天机器人的虚构。“他们会告诉你,你知道的,大象是产下最大鸟蛋的动物之一,或者其他什么,”他说。正如彭博社的Dina Bass所写的那样,这也是为什么Stack Overflow,这个面向软件开发人员的问答网站,禁止了ChatGPT在其网站上的使用。问题在于真实性:这些答案看起来是正确的,但通常是错误的,并且可以大量生产。

如果你想知道为什么科技行业对一个经常产生令人信服但不准确信息的服务如此疯狂,而且远未盈利,那么你可能没有关注过过去二十年的科技行业。平庸、廉价的内容,以工业规模创建,几乎不考虑可能导致的任何潜在危害,一直是硅谷风险投资家一再提供的商业模式,不仅仅是Demand Media,还有整整一代社交媒体公司。

事实上,ChatGPT似乎唯一可能产生重大影响的领域之一——除了抄袭之外,当然——就是社交媒体的虚假信息。在大多数情况下,胡扯可能在商业上毫无用处,但如果你想为虚假勃起功能药品创建一堆Facebook广告,或者对抗俄罗斯机器人网络,那就很棒了。人工智能研究员、纽约大学名誉教授Gary Marcus认为,ChatGPT和类似的机器人基本上是信息战的“自动武器”,它们被释放到世界上,几乎没有考虑到明显的潜在危害。在最近的一篇文章中,Marcus预测,由国家支持的虚假信息网络将利用ChatGPT,“以前所未有的规模攻击社交媒体,并制作虚假网站。”

ChatGPT确实有一些适度的应用。对于那些需要大量生成公式化散文但不一定面向人类消费的人来说,它似乎足够有用。(OpenAI最大的客户之一是Jasper,该公司将其软件用于搜索引擎优化文案等应用。)你甚至可以将其想象为更复杂创意工作的起点,作家们可以使用它来草拟一封待修改的模板信,或者作为头脑风暴的一个非常粗糙的起点。这样一来,OpenAI可能构建的更接近下一代文字处理器,而不是HAL 9000。

这些限制不会阻止未来学家幻想AI聊天机器人的巨大潜力。但重要的是要记住,一个令人信服的演示并不等同于一个改变世界的业务。—马克斯·查夫金,彭博商业周刊专栏作家

开篇

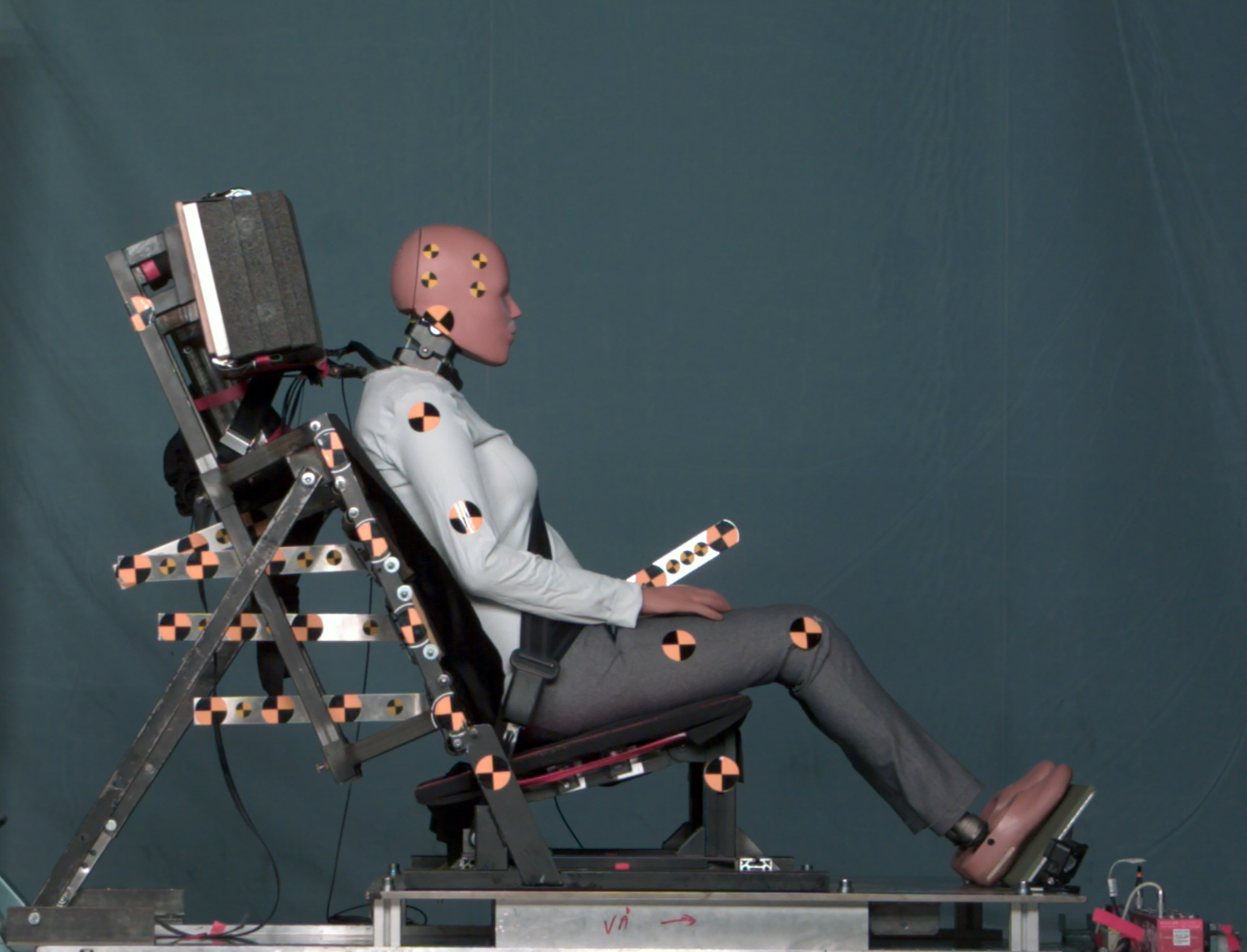

一个以普通女性为原型制作的假人。VTI提供 “数十年的技术进步和监管变革已经帮助使汽车乘客在碰撞中更加安全。但女性在正面碰撞中仍然比男性更有可能受重伤或死亡,而且三倍更有可能遭受骨折或脑震荡等伤害。瑞典工程师阿斯特丽德·林德正试图通过开发第一个以普通女性尺寸为原型的碰撞测试假人来消除这种差距。”

一个以普通女性为原型制作的假人。VTI提供 “数十年的技术进步和监管变革已经帮助使汽车乘客在碰撞中更加安全。但女性在正面碰撞中仍然比男性更有可能受重伤或死亡,而且三倍更有可能遭受骨折或脑震荡等伤害。瑞典工程师阿斯特丽德·林德正试图通过开发第一个以普通女性尺寸为原型的碰撞测试假人来消除这种差距。”

继续阅读:“如何让汽车更安全?使用与女性相似的碰撞测试假人**,作者:**Rafaela Lindeberg

敬请关注明天的Bw Daily,并查看更多内容,请访问Businessweek*!*

敬请关注明天的Bw Daily,并查看更多内容,请访问Businessweek*!*