ElevenLabs与Reality Defender合作打击深度伪造音频-Bloomberg

Daniel Zuidijk

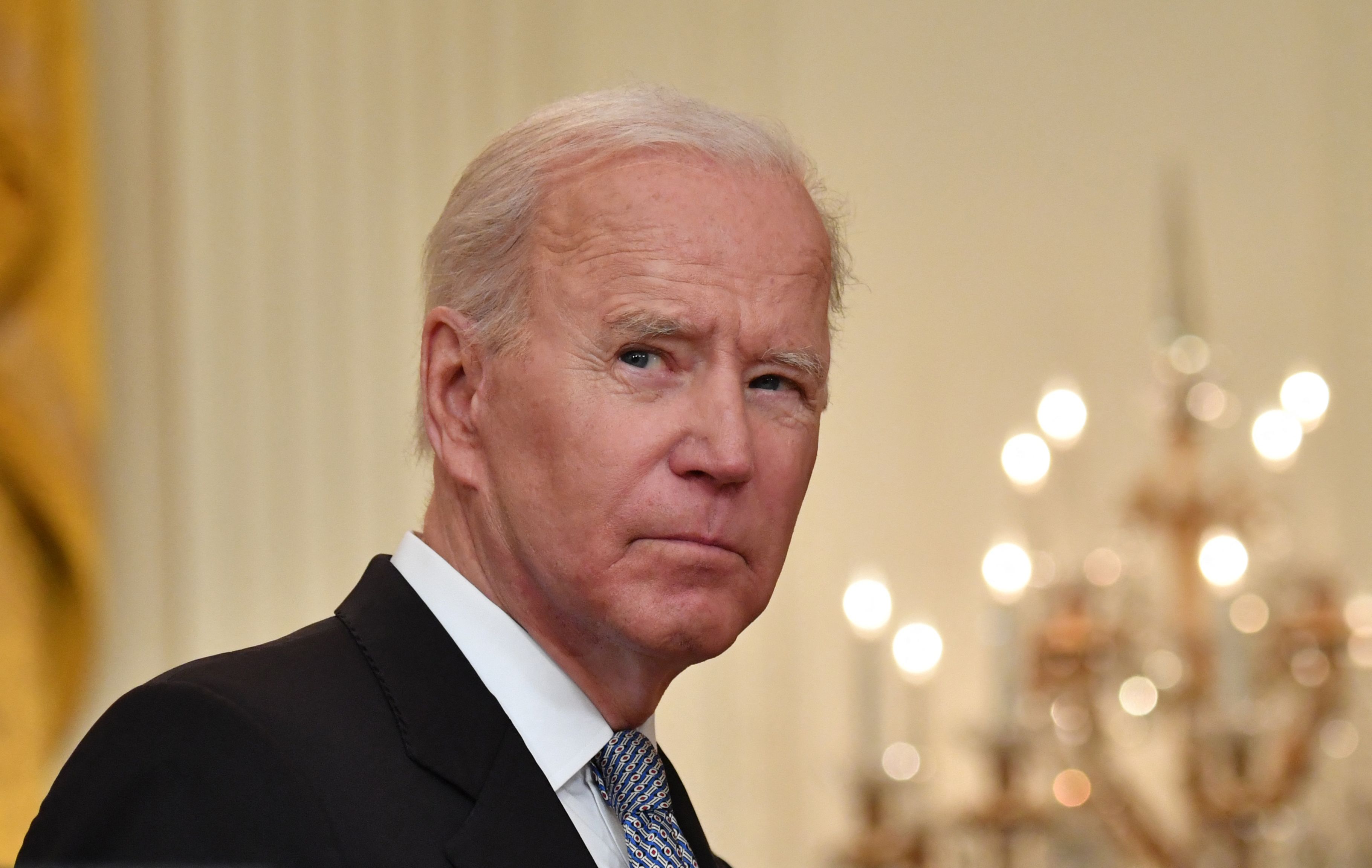

乔·拜登摄影师:尼古拉斯·卡姆/法新社/盖蒂图片社ElevenLabs,一家利用人工智能克隆人声的初创公司,正在与一家AI检测服务合作,以应对关键选举年的深度伪造威胁。

乔·拜登摄影师:尼古拉斯·卡姆/法新社/盖蒂图片社ElevenLabs,一家利用人工智能克隆人声的初创公司,正在与一家AI检测服务合作,以应对关键选举年的深度伪造威胁。

这家初创公司已与Reality Defender合作,后者是一家总部位于美国的公司,为政府、官员和企业提供深度伪造检测能力。这一合作是在今年早些时候研究人员提出担忧之后进行的称ElevenLabs的技术被滥用以制作美国总统乔·拜登的深度伪造音频。

这一合作使Reality Defender能够访问ElevenLabs的数据和模型,从而更好地检测AI生成的音频。作为回报,ElevenLabs将能够使用Reality Defender的工具来加强自身防范滥用的能力。ElevenLabs的发言人表示,该协议没有财务成分。

这一合作突显了视频、音频和基于图像的深度伪造持续上升和风险。风险是双重的 — 创作者可以使用生成式AI工具来描绘个人受害者身处虚假情境,比如深度伪造色情。人们还担心在全球选举历史性年份中,深度伪造可能被用于政治操纵。

一月份,声音欺诈检测公司Pindrop Security Inc.得出结论,流传给新罕布什尔州数千选民的美国总统乔·拜登篡改音频是使用ElevenLabs的技术创建的。据彭博新闻报道,深度伪造的制作者被停职了。

“2024年的Deepfakes已被证明是最新一代的文件伪造和用于针对公众人物和政治领袖的妥协材料,”网络安全公司Recorded Future的高级威胁情报分析师克莱门特·布里恩斯告诉彭博新闻。“各国的国家元首、民选官员和记者都是全球Deepfakes持续瞄准的目标,在大多数2024年的全球选举中也是如此。”

阅读更多: 没有法律保护人们免受深度伪造色情。这些受害者进行了反击

这些担忧与初创公司获得的风险投资稳步增长同时出现,这些初创公司提供了强大的合成媒体创作工具。

ElevenLabs成立于2022年,由前谷歌工程师皮奥特·达布科夫斯基和Palantir的前员工马蒂·斯坦尼舍夫斯基创立,已筹集超过1亿美元,在一月份估值达到11亿美元。其语音克隆技术针对的是那些可能希望在不同语言中复制自己声音的用户。尽管它禁止未经允许克隆一个人的声音,但专家们仍然担心潜在的滥用。

“我们在ElevenLabs普遍认为,如果我们继续开发新的创新产品,并真正引领生成式AI音频的发展,那么我们也需要充分意识到这些创新的潜在后果,”ElevenLabs的AI安全主管亚历克桑德拉·佩德拉舍夫斯卡在一次采访中说。

Reality Defender成立于2021年,是Y Combinator创业项目的毕业生。一位代表拒绝透露具体客户,但该公司表示已与银行、媒体公司、非营利组织和政府官员合作过。

拜登政府面临对其对中国的芯片打击措施的抵制,已告知盟友,如果东京电子公司和ASML控股继续向中国提供先进半导体技术,将考虑使用最严厉的贸易限制措施。

为了与盟友博弈,美国正在考虑是否实施一项名为外国直接产品规则(FDPR)的措施,据知情人士透露最近的讨论中提到。该规则允许该国对使用哪怕是微小量美国技术的外国制造产品实施管制。