AI能源危机推动了对更高效芯片的需求 - 彭博社

Jane Lanhee Lee

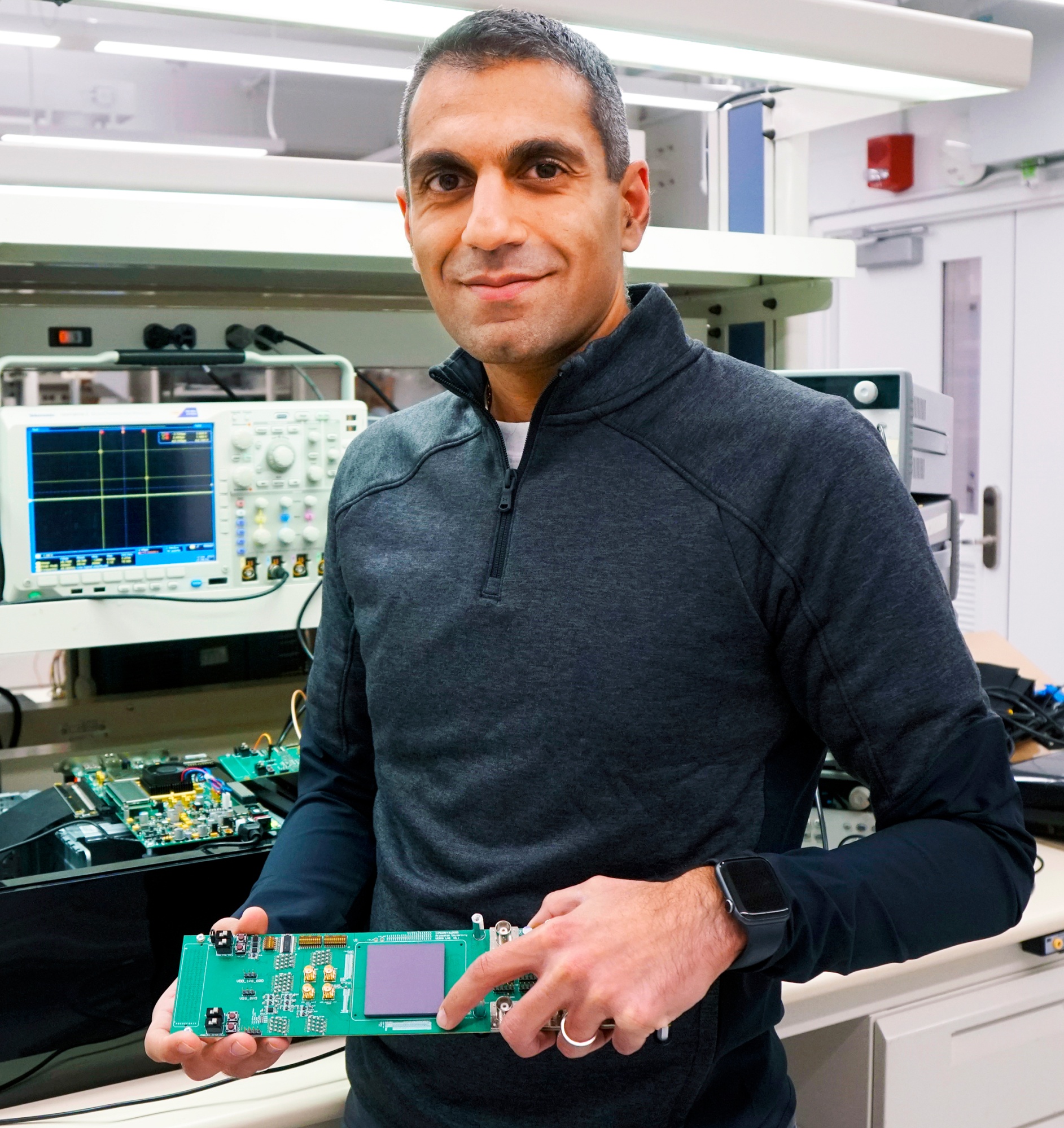

首席执行官兼创始人Sid Sheth拿着d-Matrix的Jayhawk和Nighthawk芯片。

首席执行官兼创始人Sid Sheth拿着d-Matrix的Jayhawk和Nighthawk芯片。

来源:d-Matrix提供要理解人工智能需要如此多能量的一个关键原因,想象一下一个计算机芯片充当当地图书馆的一个分支,而人工智能算法则像是一个具有借书特权的研究员。每当算法需要数据时,它会去图书馆,也就是内存芯片,借阅数据然后将其带到另一个芯片,也就是处理器,来执行一个功能。

人工智能需要大量的数据,这意味着相当于数十亿本书在这两个芯片之间来回运输,这个过程消耗了大量的电力。至少在过去十年里,研究人员一直试图通过构建可以在数据存储的地方处理数据的芯片来节省能量。“与其把书从图书馆带回家,你去图书馆做你的工作,”斯坦福大学教授、内存芯片领域的顶尖专家、也是台湾积体电路制造公司的顾问Philip Wong说道。

这个过程通常被称为内存计算,面临着技术挑战,现在才开始走出研究阶段。随着人工智能的用电量引发对其经济可行性和环境影响的严重质疑,能够使人工智能更节能的技术可能会带来巨大回报。这使得内存计算成为引起更多兴奋的话题,甚至意味着它已经开始卷入更广泛的半导体地缘政治纠纷中。

像台积电、英特尔和三星这样的主要芯片制造商都在研究内存计算。英特尔公司的高级首席工程师拉姆·克里希纳穆尔蒂表示,该公司的研究部门Intel Labs已经生产了一些芯片用于研究,尽管他拒绝透露内存计算如何适用于英特尔的产品阵容。像OpenAI首席执行官山姆·阿尔特曼、微软等公司,以及来自中国、沙特阿拉伯等地的政府机构都投资于从事这项技术的初创公司。

去年11月,一家审查具有国家安全影响的外国投资的美国政府小组强迫沙特能源公司阿美公司的风险投资基金退出了总部位于旧金山的专注于内存计算的初创公司Rain AI。据知情人士透露,阿美公司的风险投资部门现在正在寻找美国以外从事内存计算的其他公司,在中国积极进行搜索。

中国特别对这项技术表现出越来越浓厚的兴趣。根据跟踪投资数据的PitchBook,一些中国初创公司如PIM Chip、Houmo.AI和WITmem正从知名投资者那里筹集资金。普林斯顿大学教授、也是从事内存计算的初创公司EnCharge AI的联合创始人纳文·维尔马表示,他经常受邀在中国公司和大学就这个主题发表演讲。“他们正在积极尝试理解如何构建系统——内存计算系统和一般先进系统,”他说。维尔马表示,他已经好几年没有去中国了,只是在亚洲就他的学术工作发表演讲,而不是关于EnCharge技术。

EnCharge AI CEO and founder Naveen Verma在普林斯顿大学的研究实验室展示了一款原型开关电容模拟内存计算芯片。来源:Scott Lyon目前还不能确定这种芯片技术是否会成为人工智能计算未来的重要组成部分。传统上,内存计算芯片对环境因素敏感,如温度变化,这可能导致计算错误。初创公司正在努力采取各种方法来改进这一点,但这些技术都是新的。更换新型芯片成本高昂,客户通常不愿意这样做,除非他们确信会有显著的改进,因此初创公司将不得不说服客户,让客户相信风险是值得的。

EnCharge AI CEO and founder Naveen Verma在普林斯顿大学的研究实验室展示了一款原型开关电容模拟内存计算芯片。来源:Scott Lyon目前还不能确定这种芯片技术是否会成为人工智能计算未来的重要组成部分。传统上,内存计算芯片对环境因素敏感,如温度变化,这可能导致计算错误。初创公司正在努力采取各种方法来改进这一点,但这些技术都是新的。更换新型芯片成本高昂,客户通常不愿意这样做,除非他们确信会有显著的改进,因此初创公司将不得不说服客户,让客户相信风险是值得的。

目前,内存计算初创公司并未致力于人工智能计算中最困难的部分:训练新模型。在这个过程中,算法会检查千兆字节的数据,以获取用于构建系统的模式。这一过程主要由英伟达等公司设计的顶级芯片来处理。该公司一直在致力于改进功耗效率的策略,包括减小晶体管的尺寸和改进芯片之间的通信方式。

与其直接与英伟达竞争,制造内存计算芯片的初创公司的目标是在推理方面建立业务,即利用现有模型来接收提示并输出内容。推理并不像训练那样复杂,但它是大规模进行的,这意味着专门设计用于提高效率的芯片可能会有一个良好的市场。

英伟达的主要产品,一种被称为图形处理单元的芯片的高度耗电使其相对低效,不适合用于推理,d-Matrix的创始人兼首席执行官Sid Sheth说,d-Matrix是一家总部位于硅谷的芯片初创公司,已从微软公司和新加坡国有投资者淡马锡控股私人有限公司等投资者那里筹集了1.6亿美元。他说,在AI繁荣开始之前,向投资者推销是具有挑战性的。“23年上半年,每个人都因为ChatGPT而得到了,”他说。该公司计划今年销售其首批芯片,并计划在2025年实现大规模生产。

内存计算公司仍在探索其产品的最佳用途。总部位于荷兰的内存计算初创公司Axelera正在瞄准汽车和数据中心中的计算机视觉应用;总部位于德克萨斯州奥斯汀的Mythic的支持者认为内存计算在短期内非常适合应用于诸如AI动力安全摄像头之类的应用,但最终希望它们可以用于训练AI模型。

卓越的AI能源消耗规模使每个致力于使技术更加高效的人都感到紧迫,半导体研究公司的首席科学家Victor Zhirnov说,“AI迫切需要高效的能源解决方案,”他说。“否则它将很快毁灭自己。”